共计 1352 个字符,预计需要花费 4 分钟才能阅读完成。

前几天看到腾讯这个离谱的广告 — “母猪产后护理难,问腾讯元宝”后。

就一直在思考一个问题:“啥问题都知道”的 AI,在我们普通人的生活中,好像接地气的落地场景并不多?

1#

在网络中,我们用 DeepSeek 处理文本,用 SD 即梦可灵等处理图片视频;昨天用 Claude 生成好看的卡片,今天又用 GPT-4o 生成吉卜力风格的图像,大家玩得不亦乐乎,不少人快被 AI 整的焦虑了。

不过和网上的热火朝天不同,一旦回到线下的现实生活,好像身边也没多少使用 AI 的场景?

印象中,线下比较有名的例子还是用 ChatGPT 检查哪个西瓜熟了。

但这几天我发现,AI 正在悄悄影响医疗领域。

今天我们就聊聊 AI 在医疗中的真实落地场景。

2#

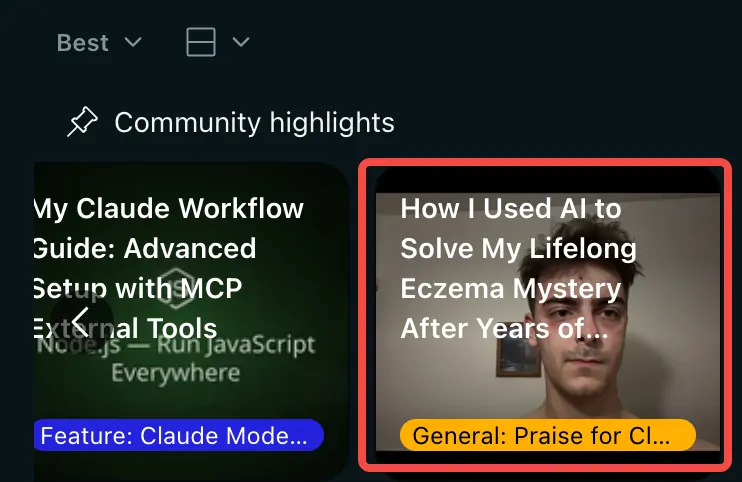

前两天在 Reddit 上看到一个帖子,帖主讲述了自己在 Claude AI 的帮助,“解决”了困扰自己多年的过敏问题。

帖主从小便有湿疹,在经历过敏源测试、咨询过敏症专家和测试过敏食物后,一直没找到理想的解决方案,仍时不时出现过敏反应。

几个月前,他尝试通过 Claude 来识别食物过敏源。

他上传了自己吃过的食物成分清单,记录哪些食物引发过敏反应及严重程度。

Claude 对这些数据进行了交叉分析,排除了引发和未引发反应的食物中的共同成分,最后得出结论:他可能对乳清分离物、浓缩物和发酵乳制品过敏。

在避免这些食物后,帖主终于摆脱了频繁的过敏反应。

最后帖主说:这并非对所有人都有效,也绝不是医疗建议,AI 也未提供过医疗建议。这只是我个人利用 AI 识别食物成分模式的经验分享。

目前这个帖子已被 Claude 社区置顶。

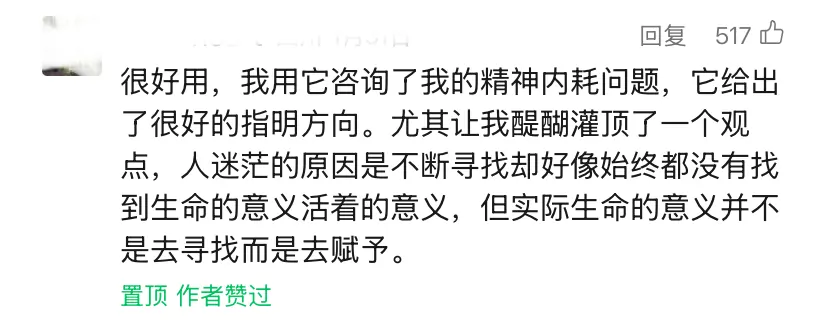

无独有偶,我想起以前发 DeepSeek 教程文章时,有一个读者的评论让我印象深刻。

现代生活中,很多人因各种原因导致心理压力大、精神内耗,却不能得到有效的心理帮助。但通过 AI,或多或少能得到一些心理慰藉。

我在小红书上曾搜过类似 “AI 让我们普通人生活更好”的例子,有限的几个例子也是和生理、心理疾病相关的。

去年我也用过 AI 来帮助自己分析检查报告。

当时不知道什么原因,一觉醒来左耳耳鸣,拖了几天后跑去医院拍片。

国内情况你也懂的,医生不会详细讲解片子和检查报告的内容,开个药就完事了。

不过我心里慌啊,立马拍照让 GPT-4o 分析分析报告,异常指标表示啥,需要注意啥,严重不严重。

几次沟通下来后,自己的疑问也都解决了,不像刚从医院出来时那样心里没底了。

你说 AI 真帮助我啥了么?

其实也就是个心理安慰。

3#

上个月 DeepSeek 爆火,很多人让 DeepSeek 生成药方,甚至微博上有个热搜:“湖南严禁使用 AI 生成处方”。

我看了下微博上的评论,大部分网友认为现在 AI 不成熟,出问题没人承担问题。

有医生网友称:医生可以用,但患者不要瞎用。

有部分网友则评论称,这是怕 AI 抢了医生的饭碗。

诚然,虽然 AI 一天一个花样,但仍有不少严肃专业的领域,即使 AI 再强,我们也无法完全放心,医疗刚好就是这个领域。

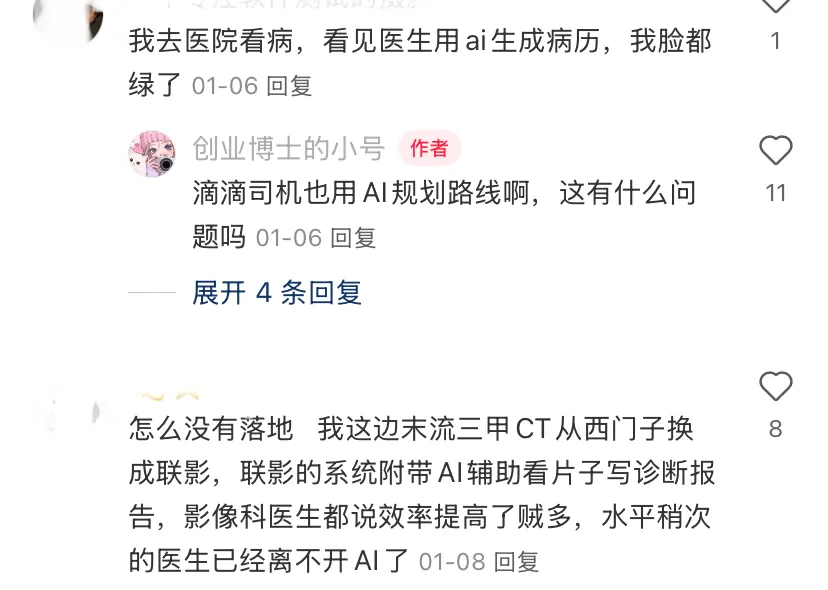

有网友称:“去医院看到医生用 AI 生成病历,脸都绿了”。

实际上,无论是“腾讯健康”小程序,还是蚂蚁的“医疗健康”小程序,都已支持 AI 健康管家,使用自家大模型和 DeepSeek-R1 组合来帮助我们答疑解惑、识别药盒、智能导诊等。

现阶段 AI 就像个聪明的小助手,能帮我们解读报告、找过敏源,但真要治病,还得靠医生坐镇。你觉得呢?

你有没有用 AI 查过自己的健康问题呢?